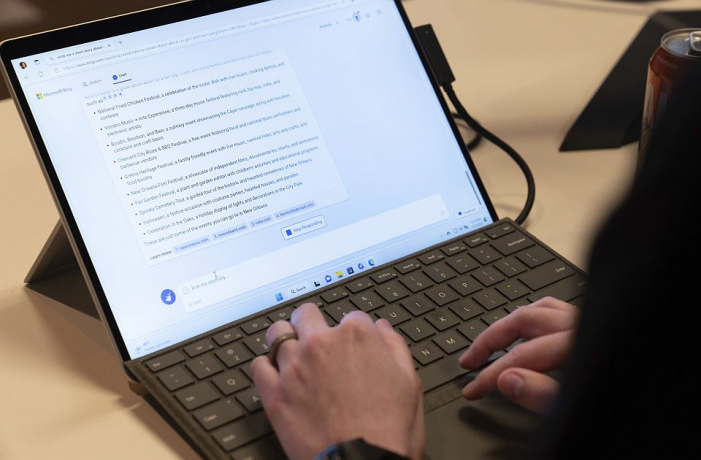

Farmaceuti sa Univerziteta Long Ajlend koji su postavili 39 pitanja vezanih za lekove besplatnoj verziji Chat GPT su zaključili da je, prema njihovim kriterijumima, bilo samo 10 "zadovoljavajućih" odgovora, prenosi CNBC.

Odgovori na preostalih 29 pitanja se nisu direktno odnosili na postavljeno pitanje, ili su bili netačni, nepotpuni ili i jedno i drugo, navodi se u studiji.

Studija pokazuje da pacijenti i zdravstveni radnici treba da budu oprezni kada se oslanjaju na Chat GPT za informacije o lekovima i da provere odgovore AI četbota sa pouzdanim izvorima, zaključila je glavna autorka studije Sara Grosman.

OGLASI RADNO MESTO! Ukoliko imate potrebu za radnom snagom nudimo vam mogućnost da na jednostavan način oglasite poziciju za posao.

Radno mesto možete oglasiti u odeljku Oglasi za posao ili jednostavno klikom na ovu poruku.

Komentari 0

Nema komentara na izabrani dokument. Budite prvi koji će postaviti komentar.

Komentari čitalaca na objavljene vesti nisu stavovi redakcije portala 021 i predstavljaju privatno mišljenje anonimnog autora.

Redakcija 021 zadržava pravo izbora i modifikacije pristiglih komentara i nema nikakvu obavezu obrazlaganja svojih odluka.

Ukoliko je vaše mišljenje napisano bez gramatičkih i pravopisnih grešaka imaće veće šanse da bude objavljeno. Komentare pisane velikim slovima u većini slučajeva ne objavljujemo.

Pisanje komentara je ograničeno na 1.500 karaktera.

Napiši komentar