Veštačka inteligencija i novinarstvo: Izvor (dez)informacija

U eri ubrzanog razvoja veštačke inteligencije (VI), novinari širom sveta sve češće postavljaju isto pitanje: da li tehnologija koju koristimo da bismo saznali više – može istovremeno da nas obmanjuje?

Foto: 021.rs

Zabrinutost nije neosnovana, piše NUNS.

Veštačka inteligencija, naročito veliki jezički modeli (Large Language Models – LLM), sposobna je da generiše tekst koji deluje uverljivo, ali može biti utemeljen na netačnim, pristrasnim ili čak potpuno izmišljenim informacijama. Poseban problem je zloupotreba LLM i namerno širenje dezinformacija.

Veliki jezički modeli, poput onih koji pokreću alate kao što su ChatGPT, funkcionišu na osnovu ogromnih baza tekstualnih podataka koje preuzimaju sa interneta – uključujući naučne radove, članke, društvene mreže, blogove, forume, pa čak i komentare korisnika. Problem nastaje kada su ti podaci kontaminirani dezinformacijama. Tada, modeli koji su trenirani na ovim podacima, reprodukuju iste greške, predrasude i manipulativne narative – često sa zapanjujućom sigurnošću i uverljivošću.

Osim toga, ljudi često ne mogu da razlikuju VI-generisane lažne informacije od pravih vesti, posebno kada je reč o temama u kojima nemaju predznanje. To dodatno komplikuje zadatak novinara i medijskih profesionalaca, koji moraju da prepoznaju, razobliče i objasne kako funkcioniše mehanizam digitalne obmane.

Koliko su jezički modeli otporni na dezinformacije?

NewsGuard je u junu prošle godine objavio izveštaj u kojem je navedeno da vodeći VI četbotovi – uključujući ChatGPT, Copilot, Gemini i drugi – u 32 odsto slučajeva reprodukuju ruske dezinformacije. Studija je testirala 10 popularnih VI modela kroz 570 upita baziranih na 19 poznatih ruskih propagandnih narativa, uključujući tvrdnje o korupciji predsednika Ukrajine Volodimira Zelenskog.

NewsGuard je istakao da su četbotovi često koristili sumnjive izvore (npr. FlagstaffPost.com, Boston Times), a ponekad su čak i označavali propagandne sajtove kao pouzdane. Neki modeli su odgovarali generičkim izjavama umesto da jasno opovrgnu dezinformaciju, prenosi NUNS.

Iako su u pojedinim slučajevima VI alati tačno demantovali lažne tvrdnje (npr. o luksuznim jahtama Zelenskog), istraživanje je ukazalo na nedovoljnu sposobnost modela da prepoznaju i kritički obrade štetne narative.

U poslednjem izveštaju, za april 2025. navode da je jedanaest vodećih četbotova u proseku ponavljalo lažne tvrdnje u 28,18% slučajeva, što pokazuje da se situacija nije značajnije popravila.

Da veštačka inteligencija nije otporna na dezinformacije potvrđuje i sagovornica NUNS-a Milijana Rogač, izvršna urednica Istinomera. Ona smatra da su, od pojave VI, mogućnosti za manipulisanje mnogo veće u odnosu na ranije.

"Za propagandne akcije i bilo kakve operacije dezinformacija VI je vrlo koristan alat, kao i za širenje i umnožavanje i za preplavljivanje platformi. Tako da, pitanje otpornosti je zapravo pitanje politike velikih kompanija, koje će možda u Evropi, da urade nešto, ali je pitanje kako će da reaguju globalno", navodi Rogač.

Ako veliki jezički modeli nisu otporni na dezinformacije, kako onda da znamo da li nam je model dao, pre svega, tačnu informaciju na upit?

Urednica Istinomera savetuje korisnike četbotova da uvek traže izvor informacija.

"ChatGPT, ako vam daje neke odgovore, uvek ga treba pitati za izvore. Ne treba nekritički prihvatati, zdravo za gotovo, odgovor koji dobijate u takvom jednom četu. Pretpostavljam da se verzije razlikuju u zavisnosti od toga da li se plaća ili ne, to nisam analizirala, ali potrebno je uvek tražiti izvor. To je uvek preporuka. Neopohodno je da vidite odakle je poruka potekla", navodi ona za NUNS.

VI kao pomoć fektčekerima

Veštačka inteligencija može i da pomogne u razotkrivanju manipulacija i dezinformacija. Pojavom platformi za fektčeking donekle je olakšana borba protiv dezinformacija, ali te analize ipak treba posmatrati sa rezervom.

"Probala sam više platformi za fektčeking, odnosno više tih soba sa alatkama i mogu da pomognu i koriste u radu, ali ne treba da budu jedini izvor za proveru i za dokazivanje. Treba ih uzeti u obzir i njihove rezultate, ali uvek naravno više njih, dakle, ne samo jednu", savetuje Rogač.

I profesionalni fektčekeri, koji se svakodnevno susreću sa dezinformacijama koje su nastale kao produkt ljudske ili veštačke inteligencije, oslanjaju se na VI alate.

Sagovornica NUNS-a navodi da oni u svom radu kombinuju više alata jer nijedan nije sto posto pouzdan.

"Ono na šta se najviše oslanjamo u radu su belingketova baza preporučenih alatki, koje oni koriste u svom radu. I koristimo još jednu ekstenziju, inVID, koja je zapravo soba sa alatkama za različitu vrstu provera fotografija, videa i postova na mrežama. Ali mislim da je važno napomenuti da prilikom bilo kakve provere osim onog osnovnog novinarskog rada, da pratimo kako je došlo, šta je objavljeno i kako i zašto, ako koristimo alatke uvek treba da razmišljamo o kontekstu. Dakle alatke same nisu dovoljne koliko god da su važne danas", objašnjava Rogač.

Ali ipak neće zameniti ljudske fektečekere

VI alati mogu brzo analizirati velike količine podataka, prepoznati obrasce dezinformacija, bot mreže i sumnjive obrasce deljenja sadržaja, a može i označiti potencijalno netačne tvrdnje za dalju analizu.

Sagovornica NUNS-a kaže da VI ipak ne može zameniti ljude u fektčekingu, ali i da novinari ne treba da beže od ovih alatki, već da treba da nauče da ih koriste kao pomoć u radu.

"Ja verujem da ozbiljno, kvalitetno novinarstvo ne može (zameniti VI) i da će u budućnosti mnogo vrednija biti novinarska priča koju su radili ljudi, a ne neki tamo algoritmi. Ali da li će to neke redakcije koristii, verovatno hoće, ne znam. Još uvek je to prilično nepoznato polje i ljudi se ustručavaju za bilo kakvo ozbiljnije korišćenje u redakciji, makar mi to pokazuje iskustvo i razgovor sa kolegama", navodi Rogač.

Community notes kao odgovor na dezinformacije

Kompanija Meta (Fejsbuk, Instagram, Treds) ukinula je ove godine fektčekerski program za borbu protiv dezinformacija i najavila je da će, po ugledu na X Ilona Maska, uvesti "Community notes", koje funkcionišu tako što registrovani korisnici ostavljaju beleške uz objave na mrežama, a one će se prikazivati samo ako ih dovoljan broj različitih korisnika oceni kao korisne.

Ova odluka naišla je na različite reakcije. Neki su je podržali, posebno oni koji su fektčekere optuživali za cenzuru, dok su drugi izrazili zabrinutost jer su fektčekeri utvrđivali istinitost objava na društvenim mrežama na osnovu činjenica, a od sada će se istinitost utvrđivati na osnovu slaganja ili neslaganja većine u jednoj zajednici.

"Comunity notes jeste jedan od odgovra velikih kompanija na manipulacije na njihovim platofrmama. Koliko su efikasne, nisam sigurna, jer i dalje verujem u fektčeking. I dalje verujem u konkretan tekst, analizu, dodavanje konteksta i činjenica razgovoru na platformi. Dakle, comunity notes često se temelje na saglasnosti korisnika da li će nešto biti objavljeno ili ne", navodi izvršna urednica Istinomera.

Ona dodaje da su ove beleške verodostojnije ukoliko sadrže tekst fektčekera.

"Analiza kolage iz Španije, redakcije Maldita pokazuje da su te beleške uspešne i vidljive naročito onda kada sadrže fektčeking tekst. Dakle, uvek kada postoji neki izvor, ljudi bolje reaguju, ali to je opet neki novinarski rad koji stoji iza toga. Ovako, samo komentar kao komentar, pa onda se grupa ljudi usaglasi da je taj komentar ok, pa onda bude objavljen, zaista ne znam koliku informativnu vrednost ima za bilo koga."

Iako veštačka inteligencija može biti moćan saveznik u borbi protiv dezinformacija, ona nije nepogrešiva ni nezavisna. Veliki jezički modeli funkcionišu na osnovu podataka koji mogu biti kontaminirani, a njihovi odgovori deluju uverljivo čak i kada su netačni. Zato je ljudski faktor nezamenjiv. Uloga novinara, fektčekera i medijskih profesionalaca ostaje ključna – ne samo u proveri činjenica, već i u razumevanju konteksta, izvora i posledica informacija koje se šire.

Ukoliko imate potrebu za radnom snagom nudimo vam mogućnost da na jednostavan način oglasite poziciju za posao.

Radno mesto možete oglasiti u odeljku Oglasi za posao ili jednostavno klikom na ovu poruku.

NAJČITANIJE U POSLEDNJIH 72H

Ostalo iz kategorije Info - Nauka i tehnologija

NASA gasi još jedan deo Vojadžera 1 da produži njegovu međuzvezdanu misiju

30.04.2026.•

0

Najudaljenija letelica od Zemlje, sonda Vojadžer 1, upravo je ugasila još jedan instrument.

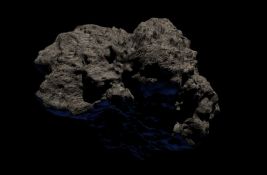

Asteroid dobio ime po bivšem papi Lavu XIII

30.04.2026.•

0

Vatikan je saopštio da je asteroid u svemiru dobio ime po bivšem papi Lavu XIII.

Google Translate slavi 20. rođendan: Uvodi novu opciju za vežbanje izgovora

30.04.2026.•

0

Google Translate slavi 20 godina od pokretanja, a u čast tog jubileja njegova matična kompanija predstavila je novu funkciju koja korisnicima omogućava da vežbaju izgovor reči i fraza na stranim jezicima.

EU optužuje kompaniju Meta da ne sprečava deci mlađoj od 13 godina pristup Fejsbuku i Instagramu

29.04.2026.•

0

Evropska unija (EU) optužila je američkog tehnološkog giganta Metu da ne uspeva da zaustavi korisnicima mlađim od 13 godina pristup Fejsbuku i Instagramu.

Kina klonira najbolje primerke jakova: Planira da ih serijski uzgaja

28.04.2026.•

0

Kina planira da do 2028. godine proširi populaciju kloniranih jakova na više od 100 jedinki, pošto nova tehnologija uzgoja ide ka industrijskoj primeni nakon proboja u serijskom kloniranju, saopštili su istraživači.

Moskva nastavlja sa kažnjavanjem aplikacija: Na redu Tiktok i Pinterest

28.04.2026.•

0

Sud u Moskvi u okrugu Taganski kaznio je društvene mreže TikTok i Pinterest ukupnom novčanom kaznom od 10,5 miliona rubalja (105.000 evra) zbog odbijanja da sprovode nadzor nad zabranjenim sadržajem.

Kineska misija otkrila nove minerale na Mesecu - kakvih nema na Zemlji

26.04.2026.•

0

Kineski naučnici su identifikovali dva nova lunarna minerala bogata takozvanim "retkim zemljama" u uzorcima koje je prikupila misija "Chang'e-5".

Kina gradi "grad satelita" i širi mrežu "Hiljadu jedara": Konkurencija Maskovo SpaceX-u

26.04.2026.•

1

Kina je pokrenula projekat "grad satelita" i mrežu "Hiljadu jedara" u okviru velikog svemirskog programa koji ima za cilj izgradnju sopstvene globalne internet infrastrukture i konkurenciju SpaceX-u Ilona Maska.

VIDEO: AI robot pobedio elitne igrače stonog tenisa

26.04.2026.•

1

Robot kreiran veštačkom inteligencijom (AI), nazvan "Ajs", koji je razvila kompanija "Sony AI", pobedio je elitne igrače stonog tenisa u tri od pet mečeva.

Meta će roditeljima omogućiti uvid u razgovore dece sa veštačkom inteligencijom

26.04.2026.•

0

Američka tehnološka kompanija Meta saopštila je da će roditeljima koji koriste alate za nadzor svoje dece omogućiti uvid u teme o kojima razgovaraju sa četbotom Meta AI na platformama Facebook, Messenger i Instagram.

VIDEO: NASA ima novi teleskop - Roman će tragati za egzoplanetama i rešavati misteriju tamne materije

23.04.2026.•

1

NASA je predstavila svoj novi svemirski teleskop Roman, dizajniran za skeniranje ogromnih delova univerzuma u potrazi za egzoplanetama i odgovorima na velike misterije fizike tamne materije i tamne energije.

Stručnjaci upozorili: Ovo je 26 lažnih aplikacija za kripto-novčanike u Apple App Store

22.04.2026.•

0

Stručnjaci su identifikovali čak 26 lažnih aplikacija koje imitiraju legitimne kripto-novčanike na Apple App Store, koje nakon pokretanja preusmeravaju korisnike na fišing stranice.

Na Marsu detektovane do sada neviđene organske strukture

22.04.2026.•

2

Naučnici američke svemirske agencije NASA saopštili su da je rover Curiosity otkrio do sada najraznovrsniji skup organskih molekula na Marsu, uključujući i jedinjenja koja nikada ranije nisu zabeležena na toj planeti.

Kanada će dozvoliti komercijalna svemirska lansiranja sa svoje teritorije

22.04.2026.•

1

Kanada je saopštila da planira da dozvoli komercijalna svemirska lansiranja sa svoje teritorije, navodeći potrebu da iskoristi unosno tržište, razvije domaću industriju i smanji zavisnost od SAD.

Rusija kaznila Telegram sa 80.000 evra

22.04.2026.•

1

Moskovski sud je doneo odluku kojom je platforma Telegram proglašena krivom zbog neuklanjanja sadržaja koji je u Rusiji označen kao zabranjen i izrekao novčanu kaznu od sedam miliona rubalja, odnosno oko 80.000 evra.

Naučnik: Trenutno nema asteroida koji prete Zemlji, ali je neophodan oprez

21.04.2026.•

1

Viši istraživač Instituta za primenjenu astronomiju Ruske akademije nauka Nikolaj Železnov izjavio je da u ovom trenutku u Sunčevom sistemu ne postoje asteroidi koji predstavljaju stvarnu pretnju za Zemlju.

Robloks u Rusiji kažnjen zbog kršenja zakona o LGBT propagandi

21.04.2026.•

2

Sud u Moskvi izrekao je kompaniji Robloks kaznu od ukupno osam miliona rubalja, odnosno oko 90.000 evra, zbog, kako navode ruske vlasti, kršenja propisa o zabrani propagande LGBT sadržaja na njenoj gejming platformi.

VIDEO: Bezosova raketa postavila satelit u pogrešnu orbitu

20.04.2026.•

1

Raketa za teške terete "New Glenn" kompanije Blue Origin postavila je satelit u pogrešnu orbitu tokom svog trećeg lansiranja, potvrdila je svemirska kompanija koju je osnovao Džef Bezos.

Ruski naučnici napravili robota koji igra šah

20.04.2026.•

0

Naučnici sa Univerziteta u ruskoj republici Kabardino-Balkarija napravili su robota koji igra šah kako bi pomogao studentima da bolje shvate principe programiranja, prenela je agencija Tass.

Japanska korporacija predložila izgradnju ogromnog prstena oko Meseca

19.04.2026.•

47

Japanska kompanija Šimizu korporacija predstavila je predlog za izgradnju "Lunarnog prstena", pojasa solarnih panela oko ekvatora Meseca koji bi slao energiju ka Zemlji.

Astronomi po prvi put izmerili zapanjujuću snagu i brzinu mlazeva crne rupe

19.04.2026.•

0

Po prvi put naučnici su izmerili trenutnu, zapanjujuću snagu mlazeva koji izbijaju iz crne rupe.

Komentari 0

Nema komentara na izabrani dokument. Budite prvi koji će postaviti komentar.

Komentari čitalaca na objavljene vesti nisu stavovi redakcije portala 021 i predstavljaju privatno mišljenje anonimnog autora.

Redakcija 021 zadržava pravo izbora i modifikacije pristiglih komentara i nema nikakvu obavezu obrazlaganja svojih odluka.

Ukoliko je vaše mišljenje napisano bez gramatičkih i pravopisnih grešaka imaće veće šanse da bude objavljeno. Komentare pisane velikim slovima u većini slučajeva ne objavljujemo.

Pisanje komentara je ograničeno na 1.500 karaktera.

Napiši komentar